2023年6月のWWDC23で発表され、世界に大きな衝撃を与えた空間コンピュータ「Vision Pro」。このまったく新しいデバイスで、快適で直感的な操作を実現するために採用されたのが、アイトラッキング(視線追跡)技術だ。ここでは、その高精度アイトラッキング技術と、その仕組みを解説していこう。

Vision Proに搭載された視線の先を認識する技術

Apple初の空間コンピュータ「Apple Vision Pro」(以降、Vision Pro)のコントローラであるポインティングデバイスは、装着しているユーザの“目線”だ。

Vision Proはユーザの目の動きをセンサで検出し、その視線が捉えている対象を特定することができる。この技術を、アイトラッキング技術と呼ぶ。

アイトラッキングは比較的古くから研究が進められていた技術で、すでにさまざまな分野で実用化されていることをご存じだろうか。

たとえばメガネ型の視線追跡デバイスは、自動車や鉄道など交通機関の運転手や航空機の操縦士の訓練に利用されており、運転中の周囲への注意や計器類の確認などを計測するのに役立っている。

また、消費者の目線を追跡することで、どのような情報に関心を持っているのかを計測し、パッケージデザインや棚割りなどマーケティングに活かすといった用途にも用いられる。

Tobiiは世界的なシェアを持つアイトラッキングデバイスメーカーだ。その代表的な製品であるTobii グラス 3は、メガネ型のコンパクトなデバイスながら、16個のLEDと4個のアイカメラを備え、優れたアイトラッキング精度を誇る。

一方でアイトラッキング技術は、手などが自由に動かせないユーザのコミュニケーションツールとしても利用されている。

基本的な動作原理はメガネ型と同じだが、細長い形状の視線追跡デバイスがディスプレイ下部に取り付けられており、利用者の視線の動きを追跡してポインタを移動させる。

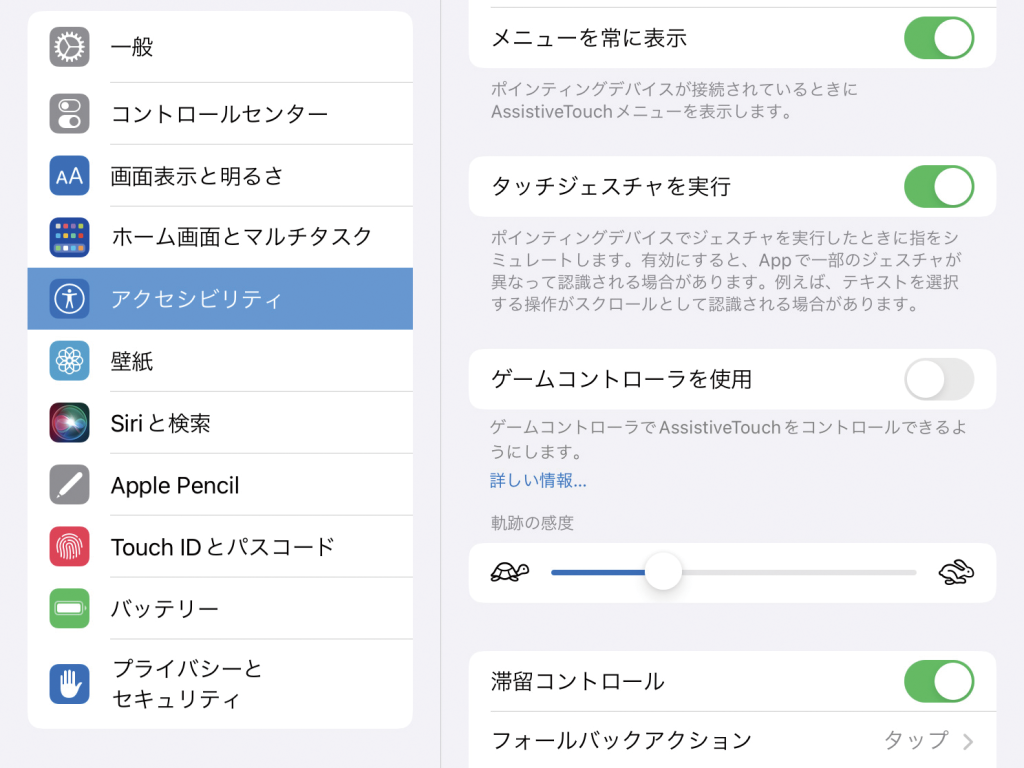

Appleは2021年9月にリリースしたiPadOS 15で他社製の視線追跡デバイスに対応し、ユーザが目だけでiPadを操作できる機能を「アクセシビリティ」に追加した。それにより、ユーザは視線の固定でクリックでき、アイトラッキングのみでiPadを操作できるようになった。

角膜反射によるアイトラッキング

アイトラッキングはさまざまな方式が実用化されているが、Vision Proが採用しているのはセンサの種類とその配置から「角膜反射(PCCR=Pupil Center Corneal Reflection)」と呼ばれる方式とみて間違いないだろう。

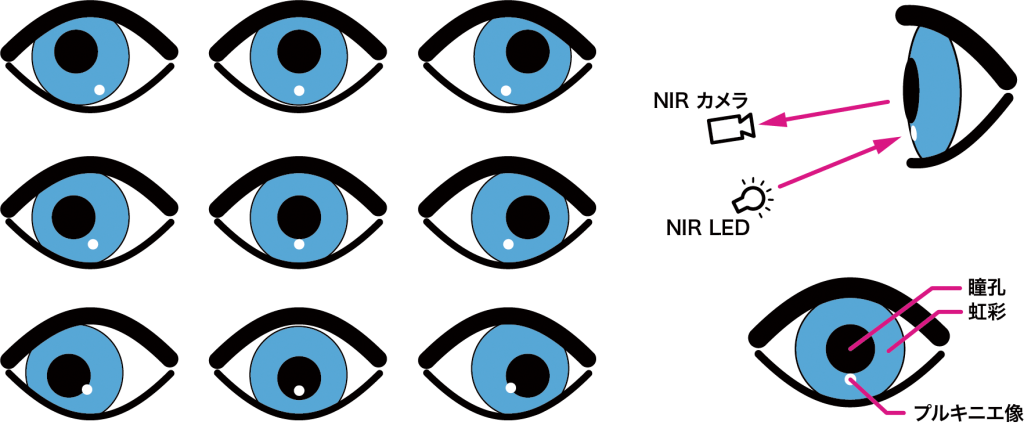

人間の目(表面の見える部分)は、白目と呼ばれる表面の膜状の「強膜」と、黒目と呼ばれるレンズ状の「角膜」で構成され、さらに角膜は中心部の「瞳孔」とそれを取り巻く「虹彩」で構成されている(虹彩は個人によってその色彩や模様が異なる)。

角膜反射方式では、視線の方向を検出するのに瞳孔と基準点の位置関係を利用しており、目の前方にLEDの点光源を配置し、その光源が瞳(角膜)に映り込んだ像(プルキニエ像)を基準点として、瞳孔の中心部の方向と距離から視線の方向を算出する仕組みだ。

LED光源が可視光(目に見える光)だとユーザの視界を妨げることから、その光源には目に見えない近赤外(NIR=Near Infra Red)LEDが用いられており、目の周り全体を撮影するのに赤外(IR)カメラが使われている。

角膜反射方式における視線測定精度は0.5度程度とされており、さまざまなアイトラッキング技術の中でも高い精度を誇るのが特徴だ。

Vision Proでは、片目あたり10個以上の近赤外LED光源と2個の赤外カメラが搭載されており、目の大きさや周りの形状の違いなどの影響を最小限に抑えることで、高精度で安定したトラッキングができるよう工夫されている。

Vision Proをユーザに最適化するキャリブレーション

アイトラッキングの精度を高めるうえで欠かせないのが、キャリブレーション(Calibration)と呼ばれる初期設定プロセスで、ユーザ個人の顔や目の形状、特徴に合わせてVision Proを最適化することが目的だ。

Vision Proの装着後、まず最初に実施するのは瞳孔間距離(IPD=Inter Pupilary Distance)の調整で、両目の瞳孔の距離に合わせて左右レンズの位置を調整する。

これはアイトラッキングのみならず、ディスプレイの位置を最適化して体験の質を向上させる意味でも重要な調整だ。手順はとても簡単で、Digital Crownの長押しで実施する。

続いてアイトラッキングのキャリブレーションの実施だ。画面に表示されるドットを目で追うことで、検出された視線と、実際にユーザが見ているポイントのズレを補正する。

Vision Proではほとんどのポインティング操作を視線で行うため、アイトラッキングには高い精度が求められることから、このプロセスは極めて重要だ。

最後に両手をVision Proの正面にかざし、ハンドジェスチャのキャリブレーションを実施することで、一連の初期設定プロセスが完了する。

画像●https://www.youtube.com/watch?v=TX9qSaGXFyg

高精度なアイトラッキングの実現には多くのパラメータを細かく調整する必要がある。しかし、Vision Proの操作には難しい点がなく、非常にシンプルでわかりやすい。複雑なキャリブレーション操作を自然かつ容易に実現している点がAppleらしいと言えるだろう。

画像●https://www.youtube.com/watch?v=TX9qSaGXFyg

おすすめの記事

ストレスのない空間コンピュータ

アイトラッキングでは、4つの近赤外線カメラより得られたイメージから瞳孔とプルキニエ像を識別し、その情報をもとにユーザの視線の先を高い精度で計算しなければならない。高度なアイトラッキング技術も、その処理に遅延が発生するとユーザエクスペリエンス(体験の質)が大幅に低下してしまうからだ。

さらに、視線入力を反映させる先は、8個の外部カメラを含むセンサ類が捉えた現実空間をベースに再生成された仮想空間と、その上にリアルタイム3Dマッピングされた仮想オブジェクトで構成された2つ(両目)のスクリーンが対象だ。これらを高解像度かつリアルタイムに処理するため専用に開発されたのが、空間処理を担うカスタムチップ「R1」だ。

画像●https://www.youtube.com/watch?v=TX9qSaGXFyg

R1の役割は、このような複雑な空間処理を、メインプロセッサであるM2からオフロードすることで、空間処理の高速化を実現すると同時に、M2の負荷を下げて発熱や消費電力を抑制する働きにある。さらに、R1が独立して空間処理を行うため、M2の負荷状態に影響を受けず、どのような状況でも遅延の極めて少ない良質なユーザエクスペリエンスを提供できるというメリットがある。

Vision Proの発売は、来年頭からアメリカで開始され、日本で発売されるのは来年末と、発売されるまでには今しばらくの時間が必要だ。しかし、Appleが世に放った「空間コンピュータ」という革新的なデバイスと、その上で提供されるアプリやコンテンツが、私たちに新たな世界を見せてくれる日が楽しみでならない。

画像●https://www.youtube.com/watch?v=GYkq9Rgoj8E

※この記事は『Mac Fan』2023年9月号に掲載されたものです。

著者プロフィール