Appleは、生成AI開発に「オープン」なアプローチを導入

Appleは、WWDC24で独自開発のAI「Apple Intelligence」を発表。それに続き、約20のCore MLモデルと4つのデータセットをHugging Faceで公開した。

Appleは研究開発に関してクローズドなアプローチをとる企業だが、WebKitやSwiftなど、一部の基盤技術ではオープンなアプローチを採用し、研究者・開発者コミュニティの協力を得て技術の進展を加速させてきた。生成AIでも同様に、Appleの取り組みがプライバシーに重点を置いたインテリジェントなAIアプリケーションの構築に取り組む開発者に力を与えると期待されている。

WebKitがHTML5やモバイルコンピューティングの成長に大きな影響を与えたように、生成AIでもAppleのオープンなアプローチが新たな時代の推進力になる可能性がある。

AI開発で「オープンな開発」と「クローズドな開発」には次のような違いがある。

- オープンな開発:ソフトウェア、アルゴリズム、データセットなどAI開発の要素を誰でも利用できるように公開して開発を進める。開発プロセスが透明になり、研究者や開発者が協力し、革新的なアイデアが生まれやすいが、知的財産の保護や品質管理が難しく、悪用リスクも存在する。例:Stable Diffusion、Meta Llama、OpenAI GPT-3。

- クローズドな開発:非公開で開発を進める。知的財産の保護や商業化が容易である一方、開発プロセスが不透明になり、研究者や開発者の参加が制限され、さまざまなアイデアや技術が反映されづらい。例:AppleのSiri、DeepMindのAlphaFold、 OpenAI GPT-4。

AI開発にどちらが適しているかは議論が紛糾している。OpenAIがオープンからクローズドに転じたように、市場における強者はクローズドなアプローチを好む傾向にあり、それによってひと握りの企業が支配的な影響力を持つリスクが高まっているのだ。

AppleのAIコミュニティへの貢献度が拡大

Appleは、Appleシリコンへのニューラルエンジン搭載とともにAI開発コミュニティに関わり始め、2017年にCore ML、2018年にCreate MLを公開。生成AIに関しても2023年末にGitHubで「Ferret」というマルチモーダル大規模言語モデルを公開するなど、AIコミュニティへの貢献を徐々に拡大していた。ただし、Google、Meta、Microsoftといったほかの大手テック企業と比較すると控えめだった。

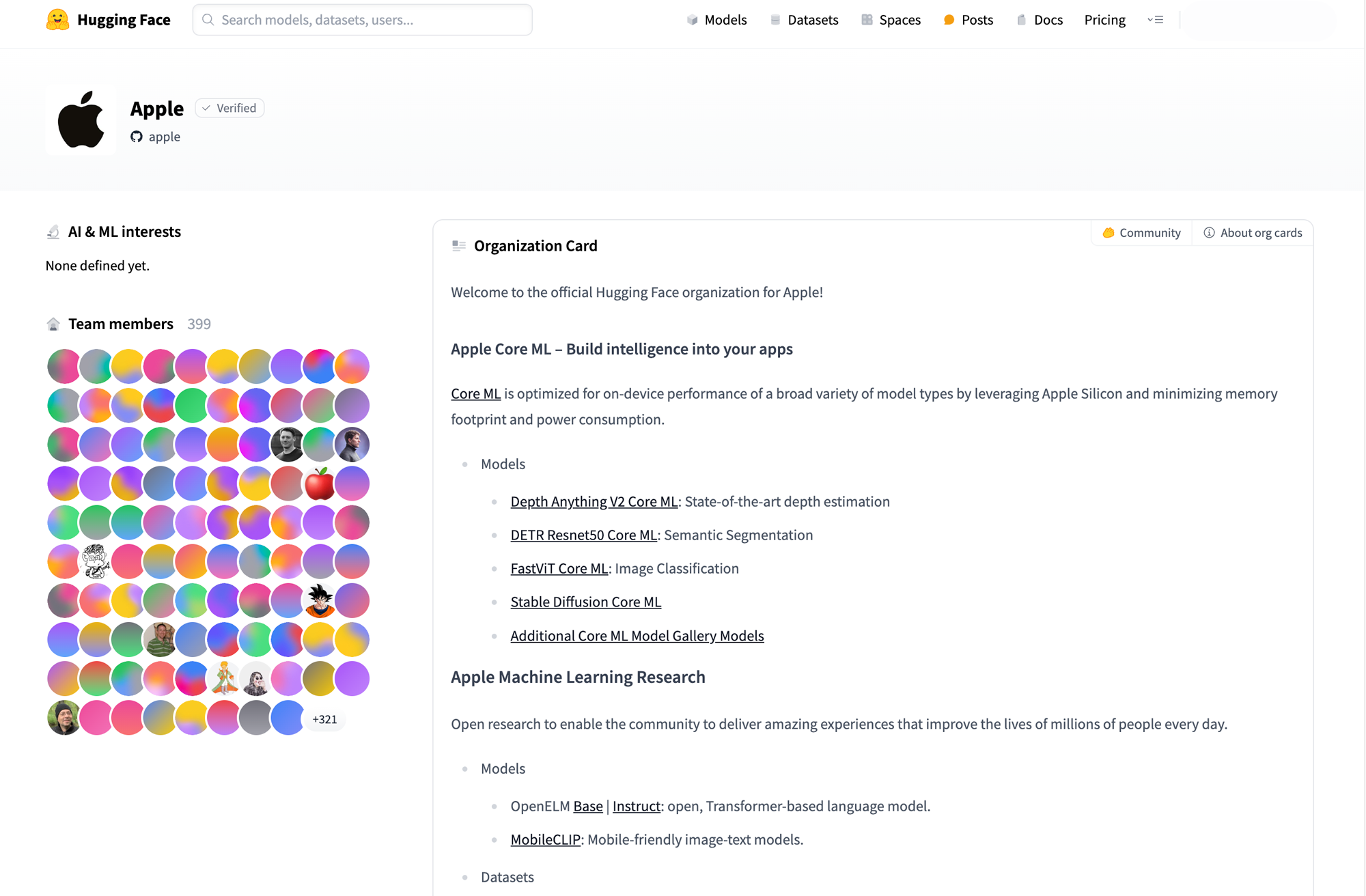

ところが今年4月、AI研究コミュニティに歩み寄るように、Hugging Faceで言語モデル「OpenELM」(ELMはEfficient Language Modelの略)を公開した。Hugging Faceは、AI・機械学習技術の研究・開発で共有と協力を促進するプラットフォームだ。オープンソースのAI研究・開発を牽引する存在であり、AIの民主化に重要な役割を果たしている。

OpenELMの公開では、Appleはモデルだけではなく、作成に使用したツールも公開した。一口にAIモデルの公開といっても、開発者が試せるだけのものから、開発者による変更が可能なものまでさまざまだ。

Appleは、開発者がOpenELMの仕組みを見て自由に利用できるようにした。それに加えて、20モデルの公開である。その間にApple Intelligenceが発表されたこともあり、Appleの技術に対するAIコミュニティの関心が高まっている。

Appleが推進する「オンデバイスAI」。取り組むデベロッパに力を

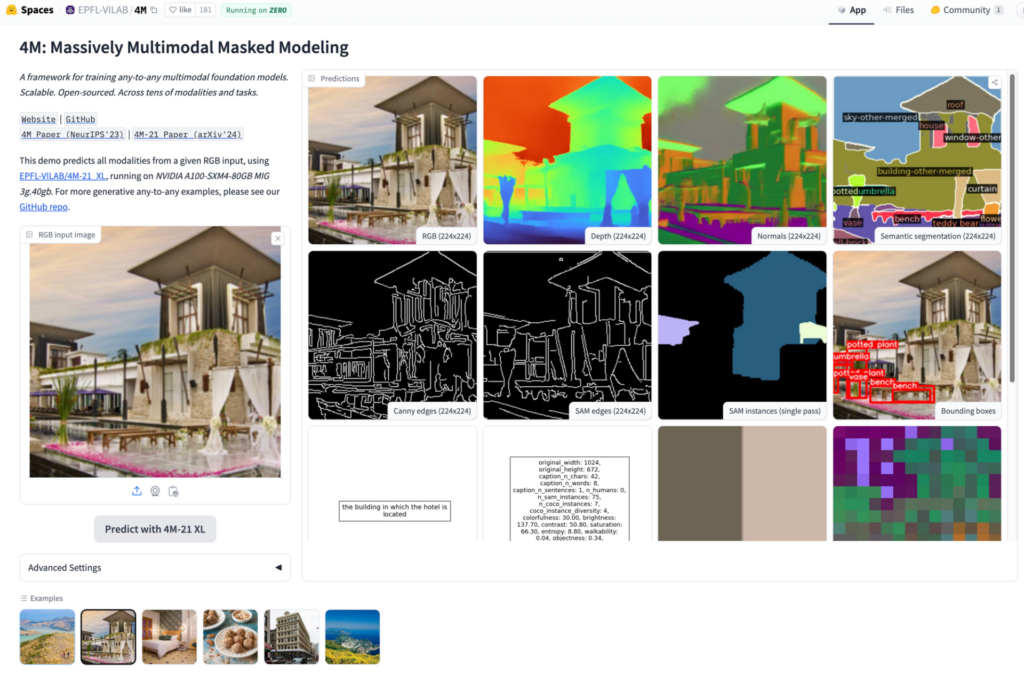

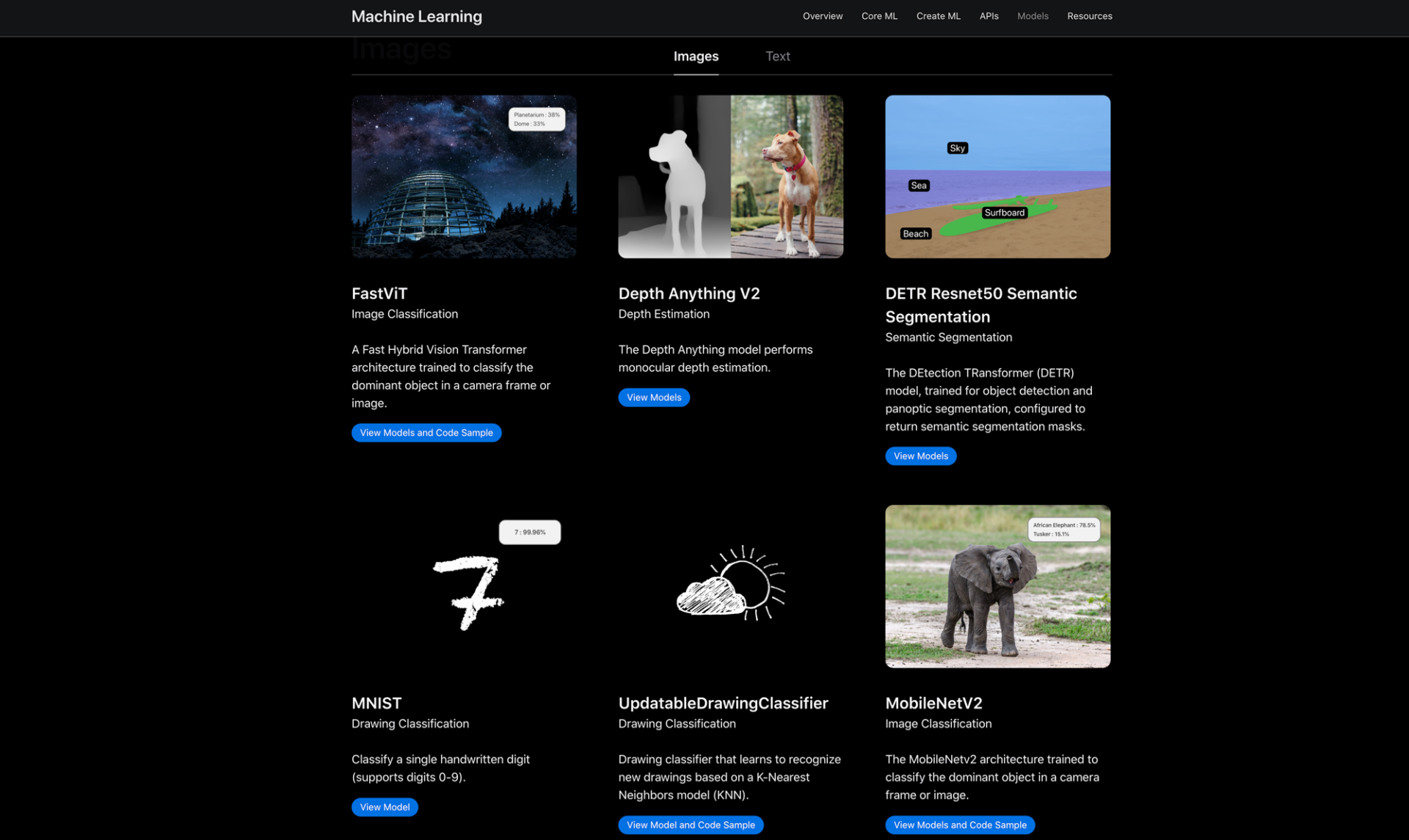

Appleは現在、同社が開発した以下のようなモデルをHugging Faceで公開している。これらのほか、OpenAIが開発したCLIP(言語と画像のマルチモーダルモデル)をAppleのデバイスで効率的に動作するように設計した「MobileCLIP」、Stable Diffusion(画像生成モデル)をAppleデバイスで直接実行できるように最適化した「Stable Diffusion Core ML」などがある。

- OpenELM:テキスト生成、翻訳、要約など、多くの自然言語処理 (NLP)タスクに対応する言語モデル。効率的な動作を特徴とし、 2億7000万/4億5000万/11億/30億パラメータの4つのモデルがある。

- Depth Anything V2 Core ML:1枚の画像からシーンの各ピクセルの深度を高精度に推定する。

- DETR Resnet50 Core ML:DEtection TRansformers(DETR)アーキテクチャに基づいたオブジェクト検出およびセグメンテーションのためのモデル。

- FastViT Core ML: Core MLフレームワークで動作するVision Transformer(ViT)モデル。高速かつ高効率に画像分類タスクを実行できる。

これらのモデルに共通するのは、「オンデバイスAI」向けに設計されていることだ。

オンデバイスAIでは、すべてのAI処理がデバイス内で行われる。そのためレスポンスが高速で、ユーザデータがデバイス内にとどまり、安全性とプライバシーが保たれるわけだ。ただし、処理能力はデバイスの性能に限定される。

AIチャットボット「ChatGPT」や画像生成サービスの「Midjourney」など、ここ数年で話題になっている生成AIサービスの多くはクラウドでAI処理を行っている。クラウドの強力な処理能力を利用できるが、ユーザが入力したプロンプトや分析に用いるデータがクラウドに送信され、それらをユーザが意図しない方法で使われたり、個人情報が漏洩するリスクを伴う。

Appleは、AIの安全性とプライバシーを高めるオンデバイスAIに生成AIの主戦場を移したいと考えている。そのために、技術のオープン化によってAIコミュニティと協力し、現時点でオンデバイスAIの短所である性能・機能を向上させようとしているのだ。

開発者は、公開された高品質なモデルにアクセスできることで、自らモデルを構築することなく生成AIを用いたアプリケーションを短期間で開発できる。クローズドなアプローチをとる一部の企業に技術が独占されることなく、AIへの参入障壁が低減し、より多くの開発者が革新的なアイデアを実現可能だ。オンデバイスAIの重要性を認める開発者が増えることは、デバイスを強みとするAppleのエコシステム強化につながる。そして、Core MLモデルを利用した革新的なアプリやサービスが増えることで、Apple製品のユーザはより良い体験を得られるようになるだろう。

激化する生成AI開発競争、安全なAIをめぐる本音と建前

今後数年で、生成AIは広く一般に浸透し、あらゆる面において私たちの効率性や生産性を変えるものになるだろう。そこで重要になるのは、2010年代の失敗を繰り返さないことである。現在の生成AIをめぐる状況は、2010年ごろの広告用トラッキングの議論に似ているのだ。

今でこそユーザも企業もプライバシーを重視するようになったが、14年前はオンラインサービスの利便性のためにユーザが個人情報を提供すべき、そのほうがデメリットをメリットが上回ると考えられていた。

以下は、2010年に独ベルリンで行われたIFAの基調講演でのエリック・シュミット氏(Eric Schmidt、当時Google CEO)の発言である。

私たちは、あなたが次に何をすべきか、何に関心があるかおすすめできます。想像してみてください、私たちはあなたがどこにいるか、何が好きかをわかっているのです

Googleがユーザの考え、好み、ロケーションを把握しているから効果的にユーザを支援できるという文脈の発言だが、Googleような企業のCEOが今このようなことを言ったら猛烈な非難にさらされるだろう。しかし、14年前は”不適切”どころか、逆にそれを聞いた多くの人がネットの可能性に期待を膨らませていたのだ。

プライバシーを重視してきたAppleは当時、ソーシャル分野で競争力がなく、ネットの趨勢を見誤っているとも指摘されていた。

ところが、2010年代後半にフェイクニュース問題、Facebookのユーザ情報流用問題などが発生し、人々のプライバシー保護に対する意識が大きく変わった。ユーザ自身による情報管理を放棄することの危うさが浸透し、今やプライバシーはAppleが信頼とユーザロイヤリティを得る大きな要因になっている。

AppleのAI開発のアプローチは、「自ら律し、そのリスクに見合う実直さを持つ」こと

現在、生成AIを手がけるほぼすべての企業が安全優先を掲げている。だが14年前のプライバシーと同様に、その解釈はさまざまであり、安全軽視が指摘されることもめずらしくない。たとえば、今年5月に米OpenAIが安全対策チームを解消したことで、責任者の一人だったヤン・ライク氏(Jan Leike)が退社し、その際に「ここ数年、(OpenAIでは)安全の文化とプロセスは新製品よりも後回しにされてきた」とOpenAIの姿勢を批判した。

AIの安全性を軽視する危うさは誰もが意識している。しかしながら、ここ数年の生成AIの目覚ましい進化、開発競争の激化から、企業はよりパワフルなAIを求める傾向にあるのが事実だ。

生成AIの体験は斬新で魔法のようであり、私たちも新しいものを見てみたいという欲求に駆られている。だが、企業間の主導権争いに引きずられ、AI開発が前のめりになって暴走したらどうなるか。可能性と同様にリスクもまた大きいのだ。

AIを手がける企業や開発者は自ら律し、そのリスクに見合う実直さを持つべきというのがAppleのAI開発のアプローチである。安全とプライバシーを優先しながら実用的なAIを提供できるように最先端の研究を進めてこそ、結果的に高度なAIの約束を果たせる。「急がば回れ」、AIは何が起こるかわからない領域だから、安全に進む道を選ぶべきなのだ。

おすすめの記事

著者プロフィール