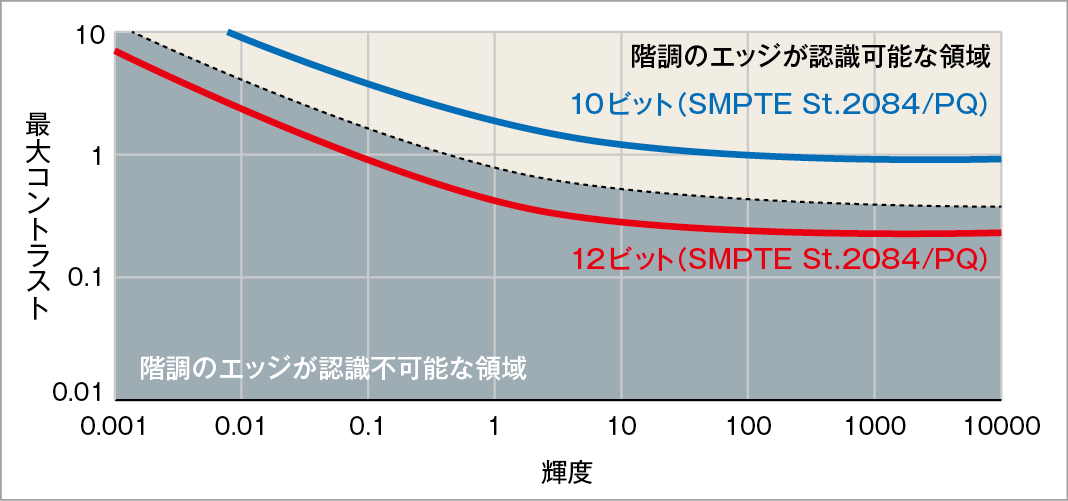

01 広角:F1.8、望遠:F2.4( って何の値? )

F値というのは、レンズにどれくらいの光が通るかを数値で示したもので、数字が低いほど明るいレンズになります。実際に撮れる写真の明るさは、F値とシャッター速度、そしてISO感度といわれる数値のバランスで決まりますが、iPhoneを使って暗いところで写真を撮ろうとした場合、F値は固定のままシャッター速度が遅くなり、ISO感度も上がっていきます。

シャッター速度が遅くなると手ブレや被写体ブレが起きやすくなり、ISO感度が上がると画質が荒くなっていきますが、レンズが明るい=F値の数字が少なければ少ないほど、シャッター速度の低下とISO感度の上昇を抑えられるのです。つまり、F値の数字が少ないレンズであるほど、暗所の撮影に強いといえます。

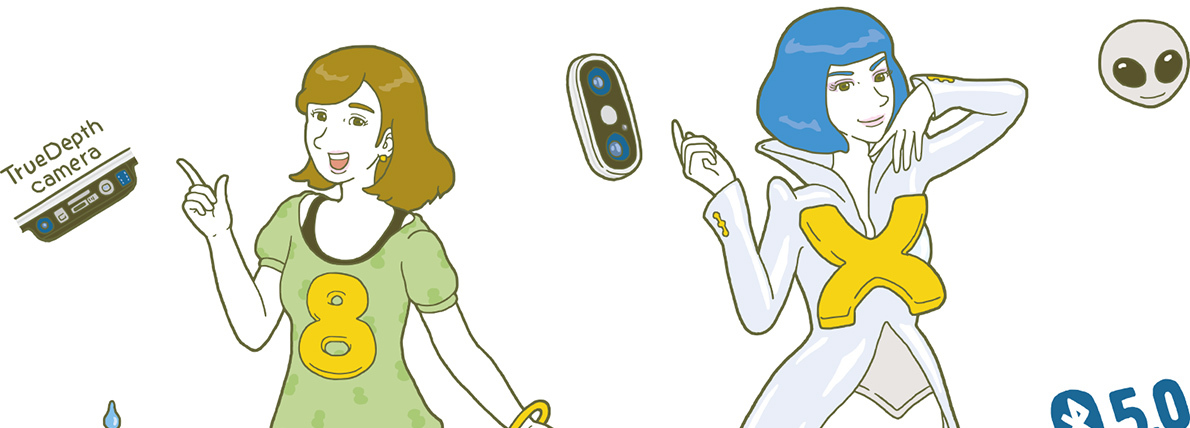

また、F値が2つ記載されているのは、iPhone Xが2つのレンズを搭載しているため。iPhone Xは、広角レンズのF値は1.8であり、iPhone 7/7 Plusや8/8 Plusと同じです。しかし、望遠レンズでは、iPhone 7 Plus/8 Plusが2.8なのに対してiPhone Xが2.4。つまり、望遠側も暗所での撮影に強いということであり、さらに2つのレンズを利用する「ポートレートモード」も暗所に強くなります。

iPhone 7 Plusで、晴天下で撮った写真と、暗所で撮った写真。どちらもF値は一緒で、ISO感度とシャッタースピードが変わっているのがわかります。

ポートレートモードはiPhone 7 Plusから搭載されていますが、室内では手ブレや被写体ブレが発生しやすいのが悩みのタネでした。iPhone Xで望遠レンズが明るくなることにより、この悩みが軽減されるはずです。

最近のiPhoneのF値。iPhone 6sのユーザからの買い替えであれば、その差をはっきり実感できると思います。

クアッドLED True Toneフラッシュ( って何ができるの? )

「クアッドLED True Toneフラッシュ」。文字だけを見るとなんだか長くて難しい用語に見えますが、この用語は「クアッドLED」と「True Toneフラッシュ」に分けることができます。どちらもカメラのフラッシュに関するものです。

まず「クアッドLED」というのは、クアッド=4つのLEDライトを搭載しているということです。この仕様はiPhone 7から搭載されていますが、LEDの数が多くなることで、より明るい写真を撮影できるようになります。また、広範囲を照らし出すことで光の均一性が高くなり、一部分だけ白飛びしてしまう自体も防げるようになります。

「True Toneフラッシュ」というのは、色の異なる2種類のLEDライトを搭載することで、自然な色合いの写真が撮れるようになる技術です。ユーザ側がライトの種類を設定することなく、iPhoneが自動で最適な発光を行ってくれます。これはiPhone 5sから搭載されています。

なお、iPhone XとiPhone 8/8 Plusでは、新たに「スローシンクロ」に対応しています。この機能は、フラッシュの通常発光とスローシャッターを組み合わせて、人物などの被写体と背景の両方を明るく見せるというもの。夜景をバックに記念撮影をしたいときなどに重宝します。デジタルカメラではモードを切り替えたり複雑な設定が必要ですが、iPhoneならユーザが特に意識することなく、スローシンクロを利用できます。

iPhone 7以降のフラッシュ部分をよく見ると、ホワイトとアンバー(琥珀色)のLEDが2つずつ、計4つ入っているのがわかります。

iPhone XとiPhone 8/8 Plusに搭載されたスローシンクロ。近くの被写体も遠くの風景も適正な露出で撮影できます。

サファイアクリスタル製レンズカバー( って一体なに? )

iPhone 5以降のiPhoneのレンズは、すべてサファイアクリスタル(ガラス)でカバーされており、ちょっとした衝撃では傷がつきにくくなっています。このサファイアクリスタルというのは、サファイアに準ずる硬度を備えた人工サファイアのことで、一部のApple Watchの文字盤にも採用されています。

硬さの尺度の1つであるモース硬度では、サファイアはダイアモンドに次ぐ「9」。鉄などの金属よりも硬く、引っ掻いて傷がつく心配が少ないのです(圧力による亀裂などがあるため、単純にモース硬度だけで硬さを判断できない点は注意)。

ディスプレイサイズ5.8インチ( ってどこの長さ? )

iPhoneに限らず、ディスプレイの大きさは対角線の長さで表現されるケースが多くなっています。1つ問題になるのは、iPhone Xのディスプレイは角が丸くなっているということ。iPhone Xの場合、5.8インチとは「角が丸くなっていないと見なした」場合の対角サイズであり、丸くなっている分実際の対角線の長さは微妙に少なくなっています。

iPhone Xのディスプレイは5.8インチですが、これまでのiPhoneに比べ縦に長く、物理的なディスプレイの横幅はiPhone 8とそれほど変わりません。それでも表示ピクセル数では、iPhone 8 Plus(1920×1080ピクセル)よりも圧倒的に多い2436×1124ピクセルというスペックを実現しています。

強化されたローカルトーンマッピング( って何が強化されたの? )

ローカルトーンマッピングとは、HDR画像の処理方法に関する用語です。iPhoneでHDRをオンにして撮影すると、内部的に3段階の露出で撮影され、それぞれのいいところ(階調が再現されている部分)が1枚の画像に合成されます。この画像処理の際、局所的(ローカル)な階調(トーン)を分析して、1枚の写真ですべてを表現できるよう調整を行う技術がローカルトーンマッピングです。

これが「強化されたローカルトーンマッピング」という記載になったのはiPhone 6sから。実際に6s以前のiPhoneと今のiPhoneで撮影したHDR写真を見比べてみれば、処理が強化されていることはハッキリとわかります。今のiPhoneで撮影したHDR画像は、被写体や周囲の状況に関わらず、いずれも鮮明で自然な階調が表現されるようになっています。

「強化されたローカルトーンマッピング」になる前のiPhone 6で撮影したHDR写真。全体的に霧がかかったような、コントラストのはっきりしない写真になっています。

iPhone 7 Plusで撮影したHDR写真。露出の調整が難しい状況でも、鮮明なHDR画像が出来上がります。

ハイブリッド赤外線フィルタ( って何の役に立つの? )

ハイブリッド赤外線フィルタとは、カメラのレンズとイメージセンサ(CMOS)の間にある、赤外線をカットするためのフィルタです。iPhoneでは、4sから搭載されています。赤外線は人間の目には見えませんが、CMOSなどのイメージセンサは赤外線に反応し、作り出す画像の色味に影響を及ぼします。たとえば、人の目には同じ色に見える服を並べて撮影したとき、赤外線を吸収する素材と反射する素材とでは作り出される画像の色味が違ってきてしまうのです。こうした赤外線の干渉を防ぎ、人間の目で見た色に近い写真を再現するために存在しているのが赤外線フィルタです。

「ハイブリッド」の意味については、フィルタの構造を説明したものと考えられます。市場には、赤外線を吸収する特性を持った樹脂に赤外線を反射するコーティングを施し、吸収+反射のハイブリッドを謳っている赤外線フィルタが存在しています。

iPhone 4s発表イベントでは、Appleのフィル・シラー上級副社長が赤外線フィルタの存在をアピール。赤外線がセンサの色再現性に影響を及ぼすと説明しました。

iPhone 4以前では、カメラを通して赤外線リモコンを見ることで、赤外線を色付きの光として見ることができました。しかし、赤外線フィルタを搭載してからは、赤外線が写るということはなくなりました。

デュアルOIS( って一体なに? )

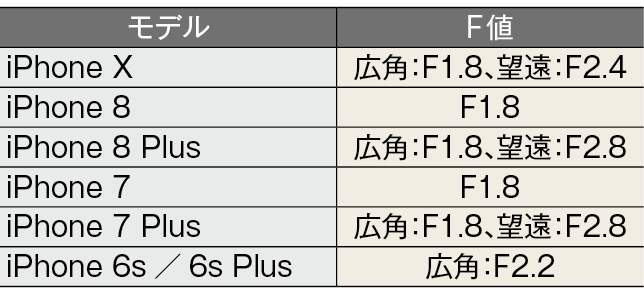

最近のAppleのサイトでは「OIS」という記載が使われていますが、これは「Optical Image Stabilizer」の略で、日本語では「光学式手ぶれ補正」となります。そもそも光学式手ぶれ補正というのは、振動センサでカメラの振動を感知し、レンズを物理的に動かすことで影響を抑える複雑な機構。iPhoneでは6 Plusから搭載していますが、スマホの小さなレンズに搭載するのはとても高度な技術です。

なお、iPhone 7 Plus/8 Plusには2つのレンズが搭載されていますが、光学式手ぶれ補正が備わっているのは広角レンズのほうだけ。一方、iPhone Xは、広角レンズと望遠レンズの両方に光学式手ブレ補正が搭載されています。ユーザにとっては、望遠レンズ側にも光学式手ぶれ補正が付いたことは大きな恩恵となります。離れた被写体を大きく見せるという構造上、望遠レンズのほうが広角レンズより手ブレの影響を被りやすいためです。

光学式手ぶれ補正の仕組み。構成レンズの一部が動くことで手ブレを打ち消します。

HDRディスプレイ( って本当にきれいなの? )

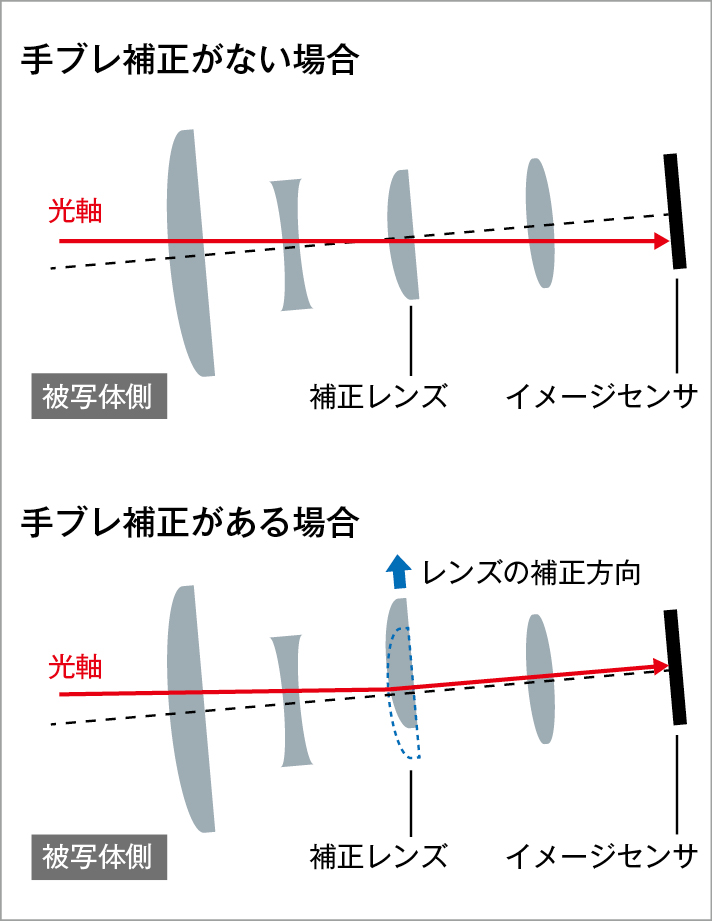

「HDR」と聞くと、iPhoneのカメラにあるHDR写真を思い浮かべる人も多いと思いますが、HDRディスプレイは似て非なるもの。HDR写真は自然界に存在する階調を従来の画像フォーマットの中で認識できるように圧縮・合成する技術なのに対し、HDRディスプレイはディスプレイ自体の階調表現を広げたものです。従来のディスプレイは明るさを8ビット、つまり256段階で表現するのが一般的でしたが、HDRディスプレイの場合は、さらに細かな階調で明るさを表現できます。

iPhone Xは、iPhoneで初めてHDRディスプレイを搭載し、「HDR10やDolby Visionにも対応」と謳っています。耳慣れない言葉かもしれませんが、これはどちらもHDRディスプレイ向けの映像コンテンツの規格です。HDR10とは、明るさの階調を10ビット(1024段階)で表現できる規格です。Ultra HD Blu-rayに採用されており、すでに対応プレーヤや対応ソフトが登場しています。一方のDolby Visionは、実に12ビット(4096段階)の階調を表現できる規格。人間の視覚で知覚できない範囲まで階調を広げたものです。

肝心なのは、これらの規格に則った映像コンテンツがiPhone向けに配信されるかどうかですが、AppleはすでにiTunesでHDR/4K対応コンテンツを配信することを表明しています。そうしたコンテンツを視聴することでiPhone Xのディスプレイの真価を実感できることでしょう。

従来の階調表現を上回るHDR10やDolby Vision。Dolby Visionは、人間が知覚できる範囲を超える階調表現を可能にしています(ドルビージャパンの発表資料をもとに作成)。

テレビやディスプレイでは、すでにHDR対応の製品が各社から発売されています。

HDRコンテンツは、映画配信サービスも各社で対応を進めています。ネットフリックスやアマゾン・プライムビデオでは、すでに対応コンテンツが配信されています。

True Toneディスプレイ( ってどういうもの? )

iPhoneではiPhone XやiPhone 8/8 Plusで初めて搭載されたTrue Toneディスプレイ。6チャンネルの環境光センサが周囲の色を判断し、画面のホワイトバランスを調節するという技術です。iPhoneに搭載される前にも、すでにiPad Proでも採用されており、文字などを読むときに目が疲れず、読みやすいと支持されています。

iPadでは、昨年3月にリリースされた9.7インチモデルからTrue Toneディスプレイが採用されました。iPhoneではiPhone X/8/8 Plusが初めてになります。

Focus Pixels( って何ができるの? )

Focus Pixelsとは、Apple独自の表現で、一般的には「撮像面位相差AF」と呼ばれる技術です。簡単にいうと、イメージセンサ上にオートフォーカスのための測定用素子を用意するという方法で、ピントの位置を素早く合わせることができるようになります。iPhoneでは6から採用されています。

撮像面位相差AFの仕組み。イメージセンサ(撮像面)上にオートフォーカス用の素子を配置し、そこに当たる信号のズレを利用してレンズのピント合わせを行います。

OLEDディスプレイ( って何ができるの? )

iPhone XのOLEDディスプレイは、有機ELとも呼ばれ、ディスプレイの新しい方式として注目を集めています。最近はOLED搭載を謳ったテレビも登場しはじめています。

OLEDは、基盤に挟み込まれた有機物質に電流を流すことで、その有機物質自体が発光するという仕組み。バックライトが不要になるため、大幅な薄型化が可能になります。さらに、OLEDは薄くシンプルな構造であるため、ディスプレイ自体を曲げることも可能です。iPhone Xでは、本体のエッジ曲面に合わせて液晶を曲げ、ボディ幅のギリギリまでディスプレイとして活用していますが、これが実現できたのもOLEDを採用したからです。

一方で、OLEDは寿命が短いというデメリットもあります。とはいえ、iPhoneは数年ごとに買い換えるサイクルが一般的であり、寿命の面を気にする必要はほとんどないはずです。

OLEDの仕組みと既存の液晶ディスプレイの仕組み。バックライトが不要になるため大幅な薄型化が実現します。

iPhone Xは、デバイスのカーブに沿ってコーナーの先端までディスプレイとして利用しています。これを実現できるもの、OLEDを採用しているためです。

100万:1のコントラスト比( って何がすごいの? )

コントラスト比というのは、ディスプレイのもっとも明るい部分ともっとも暗い部分の明るさの比率を表したもの。数値が大きいほど明暗をはっきりと表現できるようになります。iPhone 8のコントラスト比(1400:1)と比べると、iPhone Xの100万:1というスペックがどれほど高いかがわかるでしょう。

これを実現できた理由は、OLEDの搭載にあることは間違いありませんが、必ずしもすべてのOLEDがこのコントラスト比になるというわけではありません。市場には、1万:1や10万:1といったコントラスト比のOLEDディスプレイも存在しています。

なお、コントラスト比というのは、あくまで「比率」の話であり、iPhone Xの最大輝度は、iPhone 8と同じ625cd/㎡。つまり、iPhone Xと8では、もっとも暗い部分(つまり黒の部分)の表現力に大きな差があるということです。

コントラスト比の違い(イメージ)。コントラスト比が低いと明暗の差が狭くなり、高コントラスト比のディスプレイに比べフラットな画面になります。映像コンテンツなどを視聴するときは、このコントラスト比の差が臨場感の違いとして体感できるでしょう。

サブピクセルアンチエイリアス( って一体なに? )

Apple公式サイトのiPhone X紹介ページには、「サブピクセルアンチエイリアスと呼ばれる処理によって一つ一つのピクセルを調整することで、なめらかで歪みのないエッジに仕上げました」という記載があります。

サブピクセルアンチエイリアスとは、ディスプレイのピクセルを構成するRGBそれぞれの発光源を仮想的に個別のピクセルとして扱い、解像度を高める技術です。この技術を使うことで、文字などのエッジが滑らかに表現されるようになります。

ディプレイそのもののピクセル解像度は、iPhone 8が326ppi、8 Plusが401ppiに対して、iPhone Xが458ppi。これでも十分に高いのですが、サブピクセルアンチエイリアスによって、数値以上の滑らかな表示が期待できるでしょう。

サブピクセルアンチエイリアスによって、iPhone Xのディスプレイでは文字などのエッジが滑らかに表現されます。

iPhone Xに搭載されているサブピクセルアンチエイリアスのイメージです。RGBそれぞれのサブピクセルをコントロールすることで、本来の解像度以上の滑らかなエッジを表現する技術のことです。

サブピクセルアンチエイリアスの効果はサブピクセルの配置方法によって変わります。実機を確認するまで断言できませんが、iPhone XはGalaxy S8でも採用しているダイアモンドペンタイル配列と同じ配列の可能性があります。

ニューラルエンジン( って何がすごいの? )

A11 Bionicチップには、ニューラルエンジンというものが組み込まれています。具体的な用途として、AppleはFace IDやアニ文字に使っていると述べていますが、それ以外にも画像認識やARにおける空間認識など、さまざまな用途で活用されると推測されます。

近年、画像認識の精度が飛躍的に高まった背景には、ニューラルネットワークという手法の進化があります。たとえば、iPhoneやMacの「写真」で検索キーワードに「猫」と入れるだけで、自動的に猫の画像を絞り込んでくれるのは、ニューラルネットワークの進化の賜物です。このニューラルネットワークの技術は、クラウドを通じて大量のデータを蓄積することで学習を繰り返していきますが、iPhone内に専用エンジンとして入ることで、ネットワーク通信のタイムラグをなくし、素早い応答速度でさまざまな演算ができるようになるでしょう。

Appleはニューラルエンジンの用途として、Face IDやアニ文字を挙げています。また掲載された画像から、カメラのポートレートライティング機能にも利用されていることが伺えます。

「医療レベルのステンレス」( ってどんな素材? )

Appleは、iPhone Xのフレームに「医療に使われるレベルのステンレススチール」を用いていると謳っています。しかし、「医療に使われるレベル」といわれても、何がすごいのかは今ひとつピンとこないのではないでしょうか。

メスやハサミといった医療器具に使われているステンレスは、一般的に「サージカルステンレス」と呼ばれています。合金を構成する金属の配合率がほかのステンレスと異なり、高い硬度を持つのが特徴です。このステンレスをiPhoneのボディに使うことで、傷がつきにくく、いつまでも美しい光沢を保つことが可能になるのです。

さらに、サビにくい、熱に強い、腐食に強い、といった特徴のほか、金属イオンが溶け出しにくいため金属アレルギーを引き起こしにくいといわれています。今では医療器具だけでなく、ジュエリーやアクセサリをはじめさまざまな分野で活用されています。

医療器具に使われているステンレスは、一般にサージカルステンレスと呼ばれています。SUS316Lという合金がメジャーですが、その金属の配合の違いから各種のものがあります。

Appleは、iPhone Xに使われているステンレスフレームを「特別に開発した」と説明しています。医療器具などに使われるサージカルステンレスの一種ですが、その成分は独自のものである可能性があります。

HEIFとHEVC( ってどんなフォーマット? )

iOS 11では、2つの新しいファイルフォーマットに対応しました。それがHEIFとHEVCです。HEIFは画像フォーマットの1つで、高画質を保ったままファイルサイズを押さえられるのが特長です。iOS 11にアップデートすると、標準の「カメラ」アプリで撮影した写真はこのファイル形式で保存されます。macOS High Sierraもこの形式に対応していますが、サードパーティ製の画像編集ソフトの場合、非対応形式で編集できない可能性もあります。その場合は写真ソフトなどでJPEGとして書き出すといいでしょう。

一方のHEVCは、動画のコーデックです。従来のH.264と同じ画質でありながら、こちらもファイルサイズを押さえられるようになります。iOS 11の「カメラ」アプリで動画を撮るとHEVCコーデックで保存されますが、拡張子はこれまでと同じ「.MOV」であり、ファイルを見ただけではコーデックを判別できない点は注意が必要です。

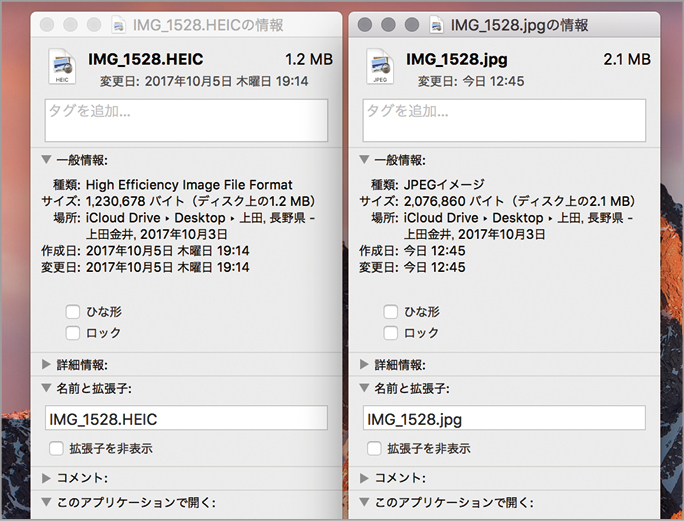

HEIFファイルは、拡張子に「.HEIC」がつきます。同じサイズの画像でも、JPEGに比べ約半分のサイズに抑えられます。

iPhoneのカメラでHEIF/HEVCを使用するかどうかは、設定で変更可能です。設定の[カメラ]→[フォーマット]で、[互換性優先]を選ぶと既存のフォーマットになります。