2026年1月12日、Googleの公式Xにおいて、GoogleとAppleによる共同声明が発表された。それはAppleが今後のAI基盤として「GoogleのAIモデル『Gemini』とその基盤技術に対し、数年間にわたる提携契約を結んだ」とする内容だった。

つまり、SiriやApple IntelligenceをはじめとするAppleデバイス上で動くAI基盤として、今後GoogleのAIプラットフォームを採用することを意味している。この契約がユーザにどのような利便性をもたらすのか。そして、今後のAppleシリコンにどのような影響を及ぼすのか、分析してみよう。

Googleとの提携がもたらす変化とは

今回の「Googleとの提携」の内容は、「現在のApple IntelligenceにおけるOpen AI(ChatGPT)との連係が、Google(Gemini)に置き換わる」といった話ではない。

iOSやmacOSといったAppleデバイスのOS、およびクラウドサービスであるPCC(Private Cloud Compute)の中核に、GoogleのAI基盤をガッツリと組み込むことを意味している。

まずは発表内容を見てみよう。要約すると以下のとおりだ。

・次世代のAppleファウンデーションモデルは、GoogleのGeminiモデルとクラウドテクノロジーを基盤とする。

(Next generation of Apple Foundation Models will be based on Google’s Gemini models and cloud technology.)

・これらのモデルは、2026年に予定されているよりパーソナライズされたSiriをはじめ、将来のApple Intelligence機能の基盤として活用される。

(These models will help power future Apple Intelligence features, including a more personalized Siri coming this year.)

・Apple Intelligenceは、Appleの業界をリードするプライバシー基準を維持しながら、引き続きAppleデバイスおよびプライベートクラウドコンピューティング上で稼働する。

(Apple Intelligence will continue to run on Apple devices and Private Cloud Compute, while maintaining Apple’s industry-leading privacy standards.)

これだけだとわかりにくいので、具体的にどのような進化が起きるのかを表で確認しよう。

この進化によって、ユーザにどのような恩恵がもたらされるのかをまとめたのが以下の表だ。

つまり、現時点で“パッとしない”とされる、Apple Intelligenceの各機能が大きく改善するわけだ。しかもそれだけではない。さらに次に挙げる機能が追加される。

ただし、ここまで積極的にAI機能が個人情報をハンドリングするとなると、プライバシーやセキュリティ面が心配だ。しかし、そこはさすがApple。抜かりはない。

AI提携が促す、Appleシリコンの進化

Appleデバイス(エッジ)上でGemini NanoのようなSLM(小規模言語モデル)を動かすうえで欠かせないのが、圧倒的なエネルギー効率を備えたAIアクセラレータの存在だ。

A11 Bionicにはじめて搭載されたANEは、生体認証(Face ID)や画像映像解析、音声言語処理、AR処理などの処理を担っていたが、Core MLの実装により汎用性が高まったことでAI処理にも使われるようになった。しかし、ANEは本来CNN(畳み込みネットワーク)処理を得意とする一方で、SLMが要求するAttention処理には最適化されていなかった。

そこでAppleは、A17 ProおよびM3においてANEの大幅なアップデートを行い、SLMの処理に必要なTransformer支援命令を追加。さらに、低精度演算「INT8」をサポートすることで、そのサイズ(トランジスタ数)を大幅に増やすことなく、性能を倍増している。

画像:Apple

しかし、今後も継続的にApple Intelligenceを強化するには、さらなるANEの進化が求められる。より低精度の「INT4」のネイティブサポート、キャッシュ階層やローカルメモリ構造の見直し、Sparsity(構造の断捨離)の最適化などが欠かせない。

つまり、SLMをより高速かつ省電力に処理するための進化が、現在のANEに突きつけられた課題だ。

Appleはおそらく近いうちに、ANEの構造を大規模に見直すアップデートを実施するはずだ。それが今年(2026年)なのか、あるいはその先なのかはまだわからないが、Appleデバイス上でAIエージェントを常駐させるためにはその進化が欠かせない。

でなければ、iPhoneのようなバッテリ容量が限られたモバイルデバイス上で、日常的にユーザに寄り添う優秀なAIエージェントを稼働させ続けることは難しい。

クラウド上のAIサーバ、PCCにも求められる進化

SiriやApple Intelligentは、基本的に端末(エッジ)上のAppleシリコンで処理されるが、より高度なAIサービスや豊富な世界知識を提供するために用意されていているのが、PCC(Personal Cloud Compute)だ。

PCCは、膨大な数のAppleシリコンで構成された大規模AIサーバで、その上でApple独自のLLM(Large Language Models、大規模言語モデル)を動かしている。

今回の提携では、ここにもGoogleが開発したGeminiがLLMとして採用されると考えられる。PCC上で稼働するのはGemini 3をベースとしたモデルで、おそらく1兆パラメータを超える規模(Gemini ProやUltra)の特注モデルだと推測される(現在PCC上で動いているモデルは約1500億パラメータと言われる)。

そしてこのPCCでも、よりLLMの実行に適した高効率なAIプロセッサが必要になる。従来のAppleシリコンに代わって採用されると考えられているのが、Broadcomとの共同開発が噂されているAIプロセッサ「Baltra」だ。

Broadcomは、2025年10月にもOpen AIとのAIプロセッサの共同開発で提携を発表している。そしてBaltraに導入されたAIテクノロジーは、将来のAppleシリコンにフィードバックされるはずだ。

ちなみに、Baltraについてはこちらの記事で詳しく解説している。下記の写真をクリックすることで、記事にアクセス可能だ。気になる方はぜひ読んでみてほしい。

AIテクノロジーに対するAppleのしたたかな戦略

AppleとGoogleは今回、GoogleのAI基盤を数年間にわたってAppleのAIプラットフォームに導入することを決めた。しかし、これは他社のAI基盤を自社のAIフレームワーク内に取り込む戦略であり、おそらくAIモデルをモジュールとしてプラグインのようなイメージで扱うものと考えられる。

つまり、より優秀、あるいは画期的なAIテクノロジーが登場したときには、Appleがそれを別のモジュールとして採用(あるいは併用)する可能性が充分あるだろう。

今回のGoogleとの提携は突然発表されたが、実際には2年以上前からその準備が進められていたものと推測される。というのも、WWDC 24の基調講演後のフォローアップ・インタビューにおいて、Appleのソフトウェアエンジニアリング担当上級副社長のクレイグ・フェデリギ氏が「将来的にはGoogle Geminiのような、ほかのモデルとの統合も視野に入れている」と発言していたからだ。

そして「Baltraプロジェクト」の情報が浮上した時期も2024年末だったことから、おそらくこの頃には本プロジェクトが進んでいたものと考えられる。

早ければ、2026年春にはこの提携の成果が姿を見せるだろう。iOS 26.4で導入するとされる新しいSiri(コードネーム:Linwood)を皮切りに、WWDC 26で更新、もしくは新たなAIサービスとそのAPIが公表されると予想できる。

そして、秋には最適化されたAIエンジンを搭載した次世代のAppleシリコンが登場するのではないかと考えられる。AIテクノロジーに対するAppleの逆襲は、まさにこれからが正念場といえそうだ。

おすすめの記事

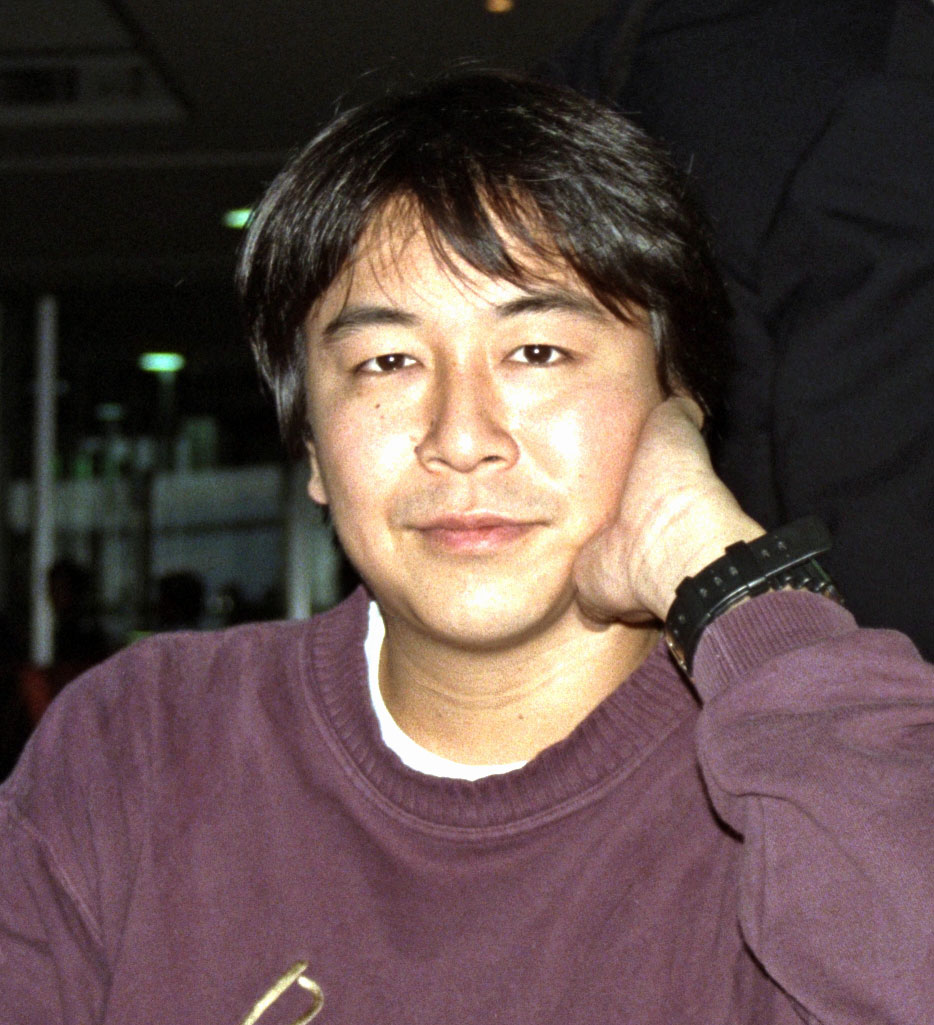

著者プロフィール