※本記事は『Mac Fan』2024年9月号に掲載されたものです。

リアルタイムで進化するDigital Twin技術

「Digital Twin」は現実の世界から収集した情報をベースに、仮想空間上にデジタルクローンを再現する技術の総称だ。収集するデータの情報量や精度を高めることで、クローンがまるで現実の双子のようにふるまうことからそう呼ばれている。一般的なシミュレーション技術と異なるのは、Digital Twinでは仮想空間上のクローンがリアルタイムで現実世界のオリジナルに合わせて変化し、その一致性を維持するように設計されている点だ。その用途は非常に多岐にわたるが、身近な事例を紹介しよう。

東京都は2019年4月に設立された「デジタルサービス局」で、現在「デジタルツイン実現プロジェクト」を進めている。同プロジェクトの情報発信サイトでは、都市の3Dマップ上に建造物や地下空間を表示させたり、「東京都水防災総合情報システム」と連係した観測データや河川カメラの映像などを表示させたりすることが可能だ。現在はまだ地域が限られていたり断片的なデータも少なくないが、今後情報量が充実していくことで、東京都そのもののDigital Twinへと成長することが見込まれる。

画像:https://info.tokyo-digitaltwin.metro.tokyo.lg.jp/

そのようなDigital Twinを構成するうえで重要なのが、現実空間のあらゆる状況を仮想空間に反映させるためのプラットフォーム(フレームワーク)の存在だ。

Digital Twinと空間コンピューティングの融合

OmniverseはNVIDIAが2021年に発表した、3Dの仮想空間(メタバース)を構築し共有することができるプラットフォームだ。これに対応するアプリはDDCツールと呼ばれ、現在では「Maya」や「Blender」、「Unreal Engine」、「LightWave」など数多くの3DアプリがOmniverseと連係できるようになっている。

Omniverseを利用することで、利用者は高度で正確なDigital Twinを効率よく構築できると同時に、それぞれの利用者は自分の得意なDDCツールを使ってメタバース上での共同作業に参加することが可能だ。また、作成されたクローンに対して仮想空間上でシミュレーションしたり、AIを活用したりすることで、さまざまな検証や実験を行える。現実世界ではリスクが想定されるような実験でも、仮想空間なら多様な条件を設定して何度でも試せるというわけだ。

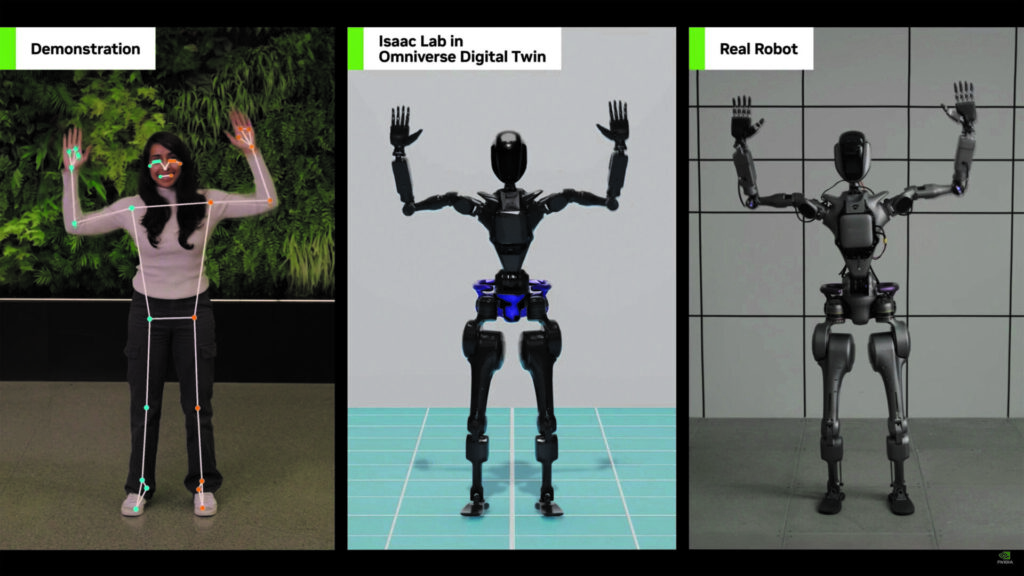

今年3月に開催された「GTC(GPU Technology Conference)2024」で、NVIDIAはOmniverseを用いたさまざまなDigital Twin活用の事例を紹介した。大規模倉庫、大型タンカー、乗用車の開発プロセス、交通システム、ヒューマノイドなどのDigital Twinの構築例が示され、近い将来には地球そのものもDigital Twinの対象となるとされた。

画像:NVIDIA

画像:NVIDIA

GTC 2024では、このOmniverseとVision Proの連係について、重大な発表があった。クラウド環境内でOmniverseを利用するための「Omniverse Cloud API」と汎用性に優れた3Dフォーマット「Open USD」をベースとしたプラットフォームに、Appleのユーザインターフェイス「Swift UI」とARフレームワークである「RealityKit」を組み合わせ、デベロッパーがVision Pro向けアプリを開発できる環境が用意されたのだ。

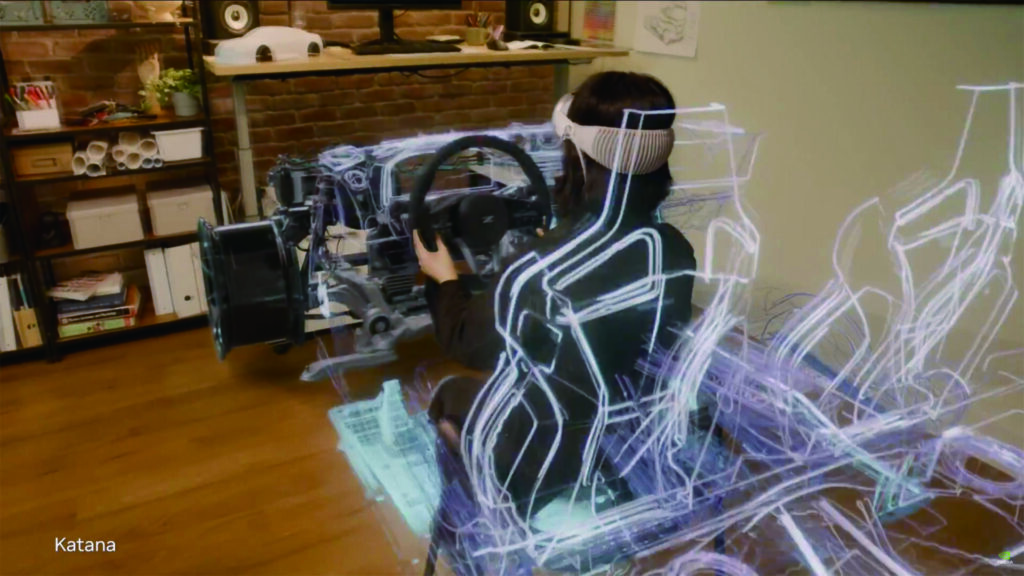

画像:NVIDIA

そこで作成されたアプリを使えば、ユーザはVision Proを通じてDigital Twinの仮想空間に入り込み、それらを直接見たり操作できるという。GTC 2024では、CGIスタジオ・Katanaが開発した車両設計アプリを利用し、Vision Proを装着したデザイナーがクルマの外観や内装を変更したり、仮想車両内に乗り込んだりする様子が披露された。

画像:NVIDIA

Appleは米国時間の4月9日、「Apple Vision Proは、空間コンピューティングの新時代をビジネスにもたらします(Apple Vision Pro brings a new era of spatial computing to business)」というニュースリリースを発表した。その中でOmniverse Cloud APIと Vision Proの連係について、「Vision Proのパワーと機能、Open USDコンテンツの高精度なレンダリング、NVIDIAのAccelerated Computingによって、次世代の没頭型デジタルエクスペリエンスを実現できるようになった」としている。

Vision Proが切り拓くDigital Twinの未来

Digital Twinの情報量と精度が向上し、作成されたデジタルクローンのリアリティが新しい次元に到達したとき、Vision Proはそれをより直接的かつ没頭型の体験ができるデバイスとして大きな役割を担うはず。

たとえば冒頭で取り上げた東京都のDigital Twinの仮想空間に、実際にVision Proを使って入り込むことが可能になる日が来るだろう。そこでは東京のさまざまな地点の今の風景を見ることができるに留まらず、水防災総合情報システムの情報を利用し実際に浸水被害が起きたときにどのような光景が眼前に現れるのかを体験したり、防災システムを作動させ災害が回避されるさまを自分の目で確認したりできるようになるはずだ。

またNVIDIAの発表にもあったように、地球そのものがDigital Twinで仮想空間上に再現されれば、たとえば気温が現在より1.5度上昇した世界というのがどういうものなのか、実際にVision Proでその光景を目の当たりにしたり、その世界を歩き回ってどんなことが起きているのかを体験したりできるようになるかもしれない。そうなればCGによるシミュレーション映像とは比較にならない実感を得ることができるだろう。

Vision Proの持つ極めて高精度な性能と機能は、高品質でリアリティに富んだ体験を一般ユーザにもたらすと同時に、ビジネスの世界にも大きな変化をもたらす可能性がある。その優れた仮想体験が数十万円で手に入るというのは、プロフェッショナルの世界では画期的なことだからだ。今後急速に普及が進むDigital Twinの世界に置いて、Vision Proの役割はますます重要になっていくだろう。

おすすめの記事

著者プロフィール